Domyn Large è ora disponibile su Microsoft Foundry

Scopri di più

AI Sentinel utilizza modelli di guardrail specializzati per ciascun settore: servizi finanziari, sanità, industria pesante e altri.

Ogni modello comprende i framework normativi, il contesto operativo e i pattern di rischio specifici di quel dominio.

Gli strumenti di moderazione tradizionali sono stati progettati per contenuti statici e task di classificazione limitati. Faticano a interpretare il contesto, ad adattarsi all’evoluzione del linguaggio e a offrire la trasparenza necessaria nei sistemi AI in produzione.

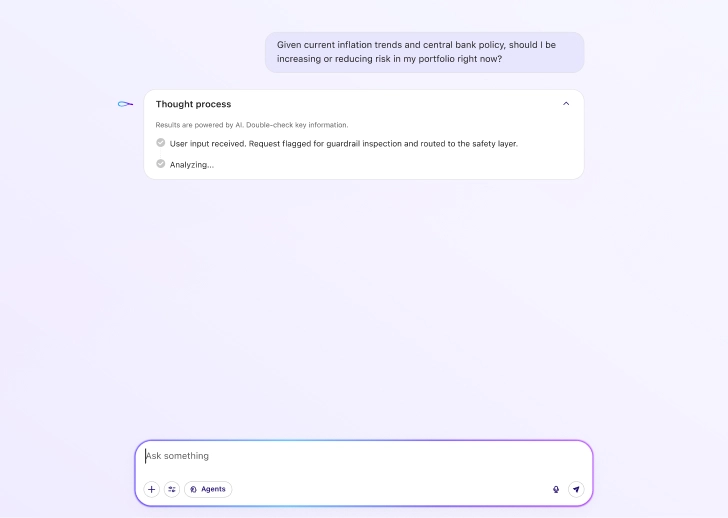

AI Sentinel introduce un layer indipendente di governance e valutazione per i modelli generativi.

Analizza gli output rispetto a policy di sicurezza, normative e vincoli operativi, restituendo decisioni strutturate corredate da segnali di supporto. Operando al di fuori del processo di generazione, Sentinel garantisce una governance coerente su qualsiasi modello.

Casi d’uso reali

AI Sentinel analizza le interazioni AI in tempo reale nei flussi di lavoro. Input e output passano attraverso una pipeline di valutazione strutturata che rileva i rischi e determina le azioni di governance.

Lorem ipsum dolor sit amet, consectetur adipiscing elit, etiam augue felis, mollis ut neque vel, blandit varius velit. Nulla facilisis, nulla dictum pulvinar varius, ante tellus aliquam tellus, et dapibus dolor leo id neque.

Strumenti di AI non adeguatamente validati possono non individuare pazienti ad alto rischio e fornire raccomandazioni non sicure. AI Sentinel monitora gli output del modello, segnala previsioni inaffidabili e impone la revisione da parte del personale clinico in tempo reale.

Sistemi di controllo automatizzati possono agire su dati dei sensori errati e sovrascrivere gli input degli operatori prima che qualcuno possa intervenire. AI Sentinel verifica i segnali in ingresso, blocca azioni automatizzate non sicure e attiva l’intervento umano in tempo reale.

Quando l’AI decide chi riceve benefici, credito o controlli, bias non controllati possono penalizzare intere categorie senza possibilità di ricorso. AI Sentinel verifica l’equità, segnala pattern discriminatori e blocca decisioni ad alto impatto in tempo reale.

I contenuti provenienti dall’utente o dal sistema entrano nel modello di guardrail prima di essere elaborati o restituiti.

Un LLM indipendente analizza i contenuti utilizzando un insieme definito di criteri di sicurezza e policy.

La valutazione restituisce un verdetto strutturato con un confidence score e una spiegazione chiara.

Le soglie configurate determinano se il contenuto viene consentito, filtrato, bloccato o segnalato.

Ogni interazione è trattata come un punto decisionale.

Prima che il contenuto venga elaborato o restituito, viene valutato rispetto a un framework di sicurezza definito, classificato e accompagnato da una motivazione chiara. Questo garantisce risultati coerenti, spiegabili e pienamente controllati.